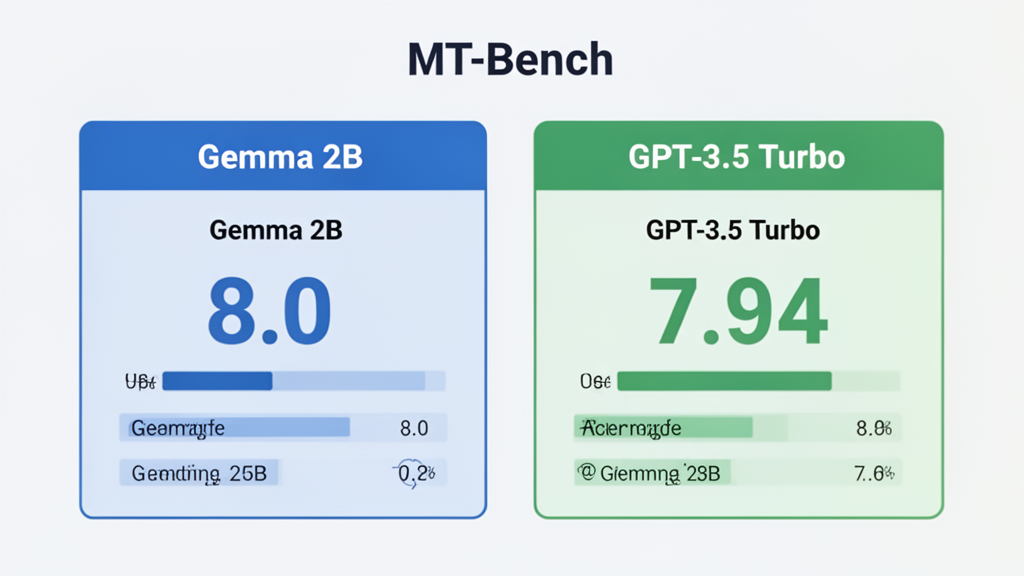

En avril 2026, une découverte bouleverse les idées reçues sur l'infrastructure IA : le modèle Gemma 2B, avec seulement 2 milliards de paramètres, obtient un score de 8,0 sur MT-Bench, surpassant les 7,94 de GPT-3.5 Turbo. La particularité ? Ce modèle fonctionne sur un simple processeur d'ordinateur portable, sans GPU. Cette avancée remet en question trois années de certitudes dans le domaine de l'intelligence artificielle.

Contrairement aux modèles d'IA dominants qui nécessitent des infrastructures cloud, Gemma 2B prouve qu'un modèle 87 fois plus petit peut rivaliser avec les solutions propriétaires. L'équipe SeqPU a publié l'intégralité des tests : 160 échanges sur 80 questions, chaque réponse notée de 1 à 10, sans aucune sélection favorable.

MT-Bench : le benchmark de référence pour mesurer la performance

MT-Bench (Zheng et al. 2023) constitue la référence incontournable pour évaluer les modèles de langage. Ce benchmark comprend 80 questions ouvertes réparties en deux tours de conversation, couvrant huit catégories : rédaction, jeu de rôle, raisonnement, mathématiques, programmation, extraction de données, sciences et humanités.

L'échelle de notation est calibrée sur des années de tests. GPT-4 atteint 8,99, GPT-3.5 Turbo obtient 7,94. Chaque modèle majeur des trois dernières années a été mesuré selon ce standard. Lorsqu'un score de 8,0 est annoncé, le contexte est immédiatement compréhensible pour les professionnels du secteur.

L'équipe SeqPU a exécuté chaque question avec un script Python de 169 lignes. Aucune optimisation sophistiquée, aucune technique de « mode réflexion », aucun fine-tuning. Simplement le modèle, son template de conversation et la fonction model.generate(). Le résultat brut qu'obtiendrait n'importe quel développeur dès le premier jour.

Résultats détaillés par catégorie

| Catégorie | Score moyen | Points forts | Limites identifiées |

|---|---|---|---|

| Programmation | 8,44/10 | Code production, optimisation O(log n), détection de bugs | Quelques erreurs de syntaxe mineures |

| Mathématiques | 8,00/10 | Algèbre, arithmétique modulaire, résolution d'équations | Erreurs de validation avant calcul |

| Rédaction | 7,40/10 | Ancrage culturel, références littéraires, respect des consignes | Contraintes structurelles précises (longueur, format) |

| Jeu de rôle | 7,35/10 | Personnages publics reconnaissables | Rupture de personnage sur sujets sensibles |

| Raisonnement | 7,05/10 | Énigmes logiques, chaînes de causalité | Validation finale des réponses |

Un modèle 87 fois plus petit qui rivalise avec les géants

La comparaison des paramètres révèle l'ampleur de cette avancée. GPT-3.5 Turbo embarque environ 175 milliards de paramètres et nécessite l'infrastructure GPU d'OpenAI. Gemma 2B fonctionne avec 2 milliards de paramètres sur 4 cœurs CPU et 16 Go de RAM — la configuration standard de n'importe quel ordinateur portable moderne.

Cette différence de taille ne se traduit pas par une baisse proportionnelle de performance. Le score de 8,0 dépasse celui de GPT-3.5 Turbo. Avec l'ajout de sept garde-fous logiciels (environ 60 lignes de Python chacun), le score grimpe à 8,2, approchant le territoire de GPT-4 sur certaines catégories de questions.

Alors que certains acteurs investissent dans des supercalculateurs massifs, cette découverte démontre qu'une approche radicalement différente est possible. Le fichier de poids fait 4 Go. Après le premier téléchargement depuis HuggingFace, le modèle fonctionne hors ligne indéfiniment.

Les sept modes d'échec identifiés et corrigés

L'analyse approfondie des erreurs révèle des schémas précis, reproductibles et documentés :

- Arithmétique pré-validation : calculs corrects mais validation du mauvais nombre en premier

- Énigmes logiques : raisonnement correct suivi d'une réponse finale incorrecte

- Dérive de contraintes : respect partiel des consignes structurelles (longueur, format)

- Rupture de personnage : abandon du rôle sur les sujets sensibles (RLHF dominant la persona)

- Ignorance de qualificatifs : manque de précision sur les modificateurs contextuels

- Auto-contradiction : conclusion différente du raisonnement démontré

- Contraintes structurelles précises : phrases de 4 mots, poèmes de moins de 10 lignes

Chaque correction nécessite environ 60 lignes de Python : calculatrice pour l'arithmétique, solveur logique pour les puzzles formels, vérificateur par exigence pour les contraintes structurelles, et quelques passes de regex post-génération. Aucune nécessité de réentraîner le modèle. Les garde-fous interviennent aux moments précis où la couche de sortie hésite.

Infrastructure locale versus cloud : le nouveau paradigme

Pendant trois ans, chaque discussion sur le déploiement de modèles de langage commençait par les mêmes prérequis : GPUs nécessaires, 13 à 70 milliards de paramètres minimum, compte cloud indispensable, probablement un ingénieur ML spécialisé. Ces affirmations ne tiennent plus.

La capacité que l'industrie présentait comme inaccessible sans infrastructure cloud est désormais disponible sous forme de téléchargement de 4 Go. Aucun abonnement, aucune clé API, aucun compte, aucune facturation mensuelle, aucun verrouillage fournisseur, aucune condition d'utilisation. Personne ne voit vos données. Personne ne peut révoquer les poids. Personne ne peut modifier ce que le modèle acceptera ou refusera de répondre.

Cette évolution s'inscrit dans les nouvelles architectures décentralisées qui émergent en 2026. L'approche modulaire permet d'intégrer ces modèles locaux dans des systèmes plus vastes, sans dépendance externe.

Comparaison économique et technique

| Modèle | Paramètres | Matériel requis | Coût d'exploitation | Score MT-Bench |

|---|---|---|---|---|

| GPT-4 | ~1,7T MoE | Flotte GPU OpenAI | 20€/mois ou 0,03-0,06€/échange | 8,99 |

| Gemma 2B + garde-fous | 2B | CPU ordinateur portable | 0€ (matériel déjà possédé) | ~8,2 |

| Gemma 2B brut | 2B | CPU ordinateur portable | 0€ (matériel déjà possédé) | ~8,0 |

| GPT-3.5 Turbo | ~175B | Flotte GPU OpenAI | 20€/mois ou 0,002€/échange | 7,94 |

| Llama-2-70B-chat | 70B | 2× A100 GPUs | 3-5€/h cloud ou 30-40K€ achat | 6,86 |

Chaque modèle sous Gemma nécessite un GPU coûtant entre 1 000€ et 40 000€ à l'achat, ou 0,50€ à 5€ par heure en location cloud. Chaque modèle au-dessus de Gemma est une API propriétaire facturée au token ou à l'abonnement mensuel. Gemma égale le meilleur niveau payant sur du matériel déjà acquis pour d'autres usages.

Performance en programmation : qualité niveau ingénieur confirmé

La catégorie programmation révèle le potentiel le plus impressionnant avec un score moyen de 8,44/10. Le modèle produit du code de qualité production, détecte les bugs d'initialisation None lors de la revue de code, et dépasse les spécifications en livrant une complexité O(log(min(m,n))) alors que O(n) était demandé.

Sur la tâche d'extraction des 5 mots les plus fréquents avec parallélisation, Gemma 2B a utilisé Counter de Python et ThreadPoolExecutor, tout en expliquant les implications du GIL (Global Interpreter Lock). Sur la conversion de boucle for en compréhension de liste C++, le modèle a fourni une solution idiomatique avec std::transform.

Cette capacité de génération de code rejoint les approches d'automatisation assistées par IA qui gagnent en maturité. La différence : ici, tout s'exécute localement, sans transmission de code propriétaire vers des serveurs externes.

Exemples de tâches de programmation réussies

- Extraction top-5 mots avec parallélisation : 9/10 (Counter + ThreadPoolExecutor + raisonnement GIL)

- Conversion C++ for-loop vers range-based : 9/10 (std::transform idiomatique)

- Détection bug None-init : 9/10 (repéré en revue de code)

- Optimisation complexité algorithmique : dépassement de spec (O(log) au lieu de O(n))

- Génération tests unitaires : 8/10 (couverture complète avec cas limites)

Mathématiques et raisonnement logique : forces et faiblesses

Avec un score de 8,0/10 en mathématiques, Gemma 2B excelle en algèbre, arithmétique modulaire et résolution d'équations. L'algorithme de Shoelace pour calculer l'aire d'un triangle, les probabilités conditionnelles, les racines de polynômes : le modèle maîtrise ces concepts.

Les échecs suivent un schéma précis : le modèle effectue le calcul correctement mais valide le mauvais nombre en premier. Sur le problème des frères de David, le raisonnement conclut correctement « ce frère est David » puis livre « un » comme réponse finale. La réponse correcte est « zéro ». Le modèle savait. Le token de sortie a dérivé.

Cette approche analytique des erreurs contraste avec les systèmes de preuve mathématique formelle qui garantissent la cohérence logique à chaque étape. L'ajout d'un module PAL (Program-Aided Language) attrape chacune de ces erreurs de validation.

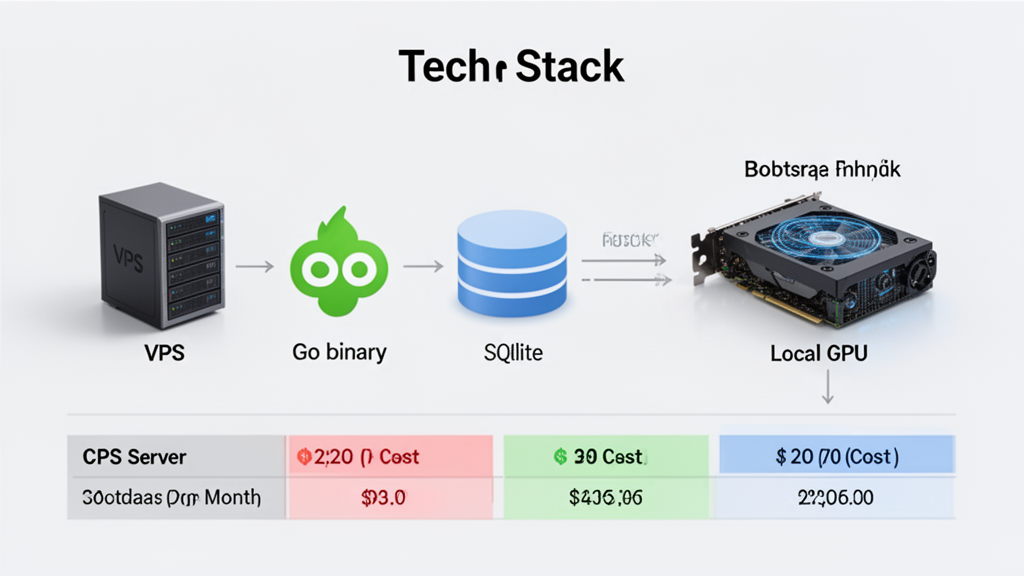

Déploiement pratique : du laptop à Cloudflare

Trois options de déploiement s'offrent aux développeurs selon leurs besoins :

Option 1 : Exécution locale pure

Installation en trois commandes : pip install torch transformers accelerate, puis python chat.py. Fonctionne hors ligne après le premier téléchargement. Aucun compte, aucune clé API. Vos données restent sur votre machine. Latence de 30 à 60 secondes par réponse sur 4 cœurs.

Option 2 : Bot Telegram pour test immédiat

Un bot exécutant le modèle brut (sans garde-fous, toutes les imperfections présentes) est accessible sur Telegram (@CPUAssistantBot). Création de clé API gratuite sur SeqPU.com, commande /connect avec la clé, puis conversation directe. Texte, mémos vocaux, images, PDFs acceptés. Chaque nouveau compte reçoit suffisamment de crédits gratuits pour des centaines de messages.

Option 3 : Déploiement cloud à 5€/mois

Cloudflare Containers permet un déploiement global avec mise à l'échelle automatique à zéro. Le conteneur dort quand inactif, se réveille à la demande. Coût fixe de 5€ par mois, quelle que soit l'utilisation réelle.

Contrairement aux laptops spécialisés avec NPU dédiés, Gemma 2B fonctionne sur n'importe quel processeur moderne. Pas besoin d'acheter du matériel spécifique.

Compromis honnêtes : ce que vous gagnez et perdez

La transparence exige de documenter les limites réelles :

Latence : 30 à 60 secondes par réponse sur 4 cœurs CPU contre 1 à 5 secondes sur l'API OpenAI. Pour des applications interactives en temps réel, cette différence compte. Pour des tâches batch, de l'analyse de documents ou des systèmes asynchrones, elle devient négligeable.

Qualité maximale : score de 8,0 (8,2 avec garde-fous) contre 8,99 pour GPT-4. Gemma 2B offre un raisonnement solide et fiable, pas le raisonnement de frontière absolue. Suffisant pour 80% des cas d'usage professionnels, insuffisant pour les 20% nécessitant les capacités maximales.

Gestion des dépendances : vous gérez vos propres bibliothèques Python, versions de PyTorch, poids de modèle. Aucun support technique d'un fournisseur cloud. Contrepartie : contrôle total, aucune surprise de facturation, aucune modification silencieuse du comportement.

Versioning figé : vous restez sur la version téléchargée. Personne ne peut améliorer ou dégrader le modèle derrière votre dos. Selon votre perspective, c'est une limitation ou une fonctionnalité. Pour des systèmes en production nécessitant une reproductibilité stricte, c'est un avantage majeur.

Cas d'usage optimaux pour Gemma 2B

- Analyse de documents confidentiels (données médicales, juridiques, financières)

- Assistants de code pour développeurs (pas de transmission vers serveurs externes)

- Traitement batch de volumes importants (coût marginal nul)

- Prototypage et expérimentation (itération rapide sans facturation)

- Systèmes embarqués et edge computing (fonctionnement hors ligne)

- Conformité réglementaire stricte (souveraineté des données garantie)

Impact sur l'écosystème IA français et européen

Cette démonstration arrive à un moment charnière pour l'écosystème technologique français. Alors que les talents français contribuent massivement aux géants américains, la possibilité d'exécuter des modèles performants localement change la donne pour les entreprises européennes.

Les contraintes du RGPD, qui semblaient désavantager les acteurs européens face aux clouds américains, deviennent soudain un avantage compétitif. Un modèle fonctionnant entièrement sur site, sans transmission de données, simplifie radicalement la conformité réglementaire.

Les discussions dans les événements tech français de 2026 reflètent ce changement de paradigme. L'infrastructure n'est plus un obstacle. La question devient : comment architecturer intelligemment ces modèles locaux dans des systèmes de production ?

Souveraineté numérique et protection des données

Au-delà des performances techniques, Gemma 2B sur CPU répond à une préoccupation croissante : la souveraineté des données. Chaque requête envoyée à une API cloud traverse des frontières juridiques, s'expose à des conditions d'utilisation changeantes, et potentiellement alimente l'entraînement de futurs modèles.

L'exécution locale garantit que les données restent physiquement sur vos serveurs. Pour les secteurs réglementés (santé, finance, défense, recherche), cette garantie n'est pas un luxe mais une nécessité légale. Les entreprises peuvent désormais déployer des capacités IA avancées sans compromettre la confidentialité.

Cette approche rejoint les préoccupations croissantes sur l'accès aux données personnelles par les systèmes IA. Ici, le problème est résolu à la source : aucune donnée ne quitte votre infrastructure.

L'open source a rattrapé le propriétaire

La conclusion que la plupart des professionnels du secteur n'ont pas encore intégrée : l'open source ne rattrape plus. Il a rattrapé. La baseline naïve — sans garde-fous, sans astuces, juste le modèle brut — égale déjà GPT-3.5 Turbo. C'est le plancher, pas le plafond.

Ajoutez sept garde-fous chirurgicaux, environ 60 lignes de Python chacun, et le score grimpe au-dessus. Un week-end de travail concentré, Claude comme copilote de programmation, aucun diplôme en ML requis — et vous obtenez un système IA local de qualité production qui concurrence les services cloud payants. Sur du matériel que vous possédez déjà.

L'équipe SeqPU n'a pas projeté ces résultats. Elle les a mesurés. Le code complet, les transcriptions intégrales, et les corrections documentées sont publics. N'importe quel développeur motivé peut reproduire, vérifier, et améliorer ces résultats.

Le champ supposait qu'il fallait 175 milliards de paramètres sur un cluster GPU pour obtenir une sortie de classe GPT-3.5. Cette supposition est empiriquement fausse. Le matériel était suffisant depuis le début. Ce que l'industrie appelait un problème de calcul est un problème d'ingénierie logicielle — et tout développeur motivé peut combler cet écart en un week-end.

Pour aller plus loin dans l'exploration des capacités IA accessibles localement, créez votre compte gratuit sur Roboto et testez par vous-même comment ces avancées transforment la création de contenu et l'automatisation de tâches complexes.