En mars 2026, les agents IA de codage suscitent autant d'enthousiasme que de controverses dans l'industrie du développement logiciel. Des géants comme Notion, Spotify et Stripe adoptent massivement ces outils promettant de générer du code plus rapidement et à moindre coût. Pourtant, derrière cette apparente révolution se cachent des réalités préoccupantes que tout professionnel devrait considérer avant d'intégrer ces technologies dans ses projets.

Cet article examine quatre problématiques majeures liées aux agents IA de codage : l'atrophie des compétences, les coûts artificiellement bas, les injections de prompts et les questions de propriété intellectuelle. Comprendre ces enjeux permet de prendre des décisions éclairées sur l'utilisation de l'IA générative dans le développement logiciel.

L'Atrophie des Compétences : Quand l'IA Érode l'Expertise

L'un des risques les plus insidieux des agents IA de codage réside dans la transformation progressive du rôle du développeur. Plutôt que d'écrire du code, l'ingénieur devient un superviseur d'agents IA, à la manière d'un manager technique. Cette évolution, bien que séduisante en apparence, pose un problème fondamental : la perte progressive des compétences techniques.

Le Déclin Progressif de l'Expertise Technique

Les développeurs qui cessent de coder activement voient leurs compétences s'atrophier avec le temps. La pratique régulière et les retours de pairs constituent des piliers essentiels du maintien et du développement de l'expertise en programmation. Sans ces éléments, même les ingénieurs expérimentés perdent leur capacité à distinguer un bon code d'un mauvais.

Cette dynamique s'apparente à celle observée dans le monde du travail numérique, où l'automatisation modifie profondément les compétences requises. La différence majeure ? Un développeur qui ne code plus ne peut plus évaluer efficacement la qualité du code produit par les agents IA.

La Complaisance Inévitable Face au Volume

À mesure que les organisations réduisent leurs effectifs en misant sur les agents IA, les développeurs restants doivent superviser un nombre croissant d'agents. Cette charge de révision devient rapidement ingérable. Même avec les meilleures intentions, la fatigue s'installe et la vigilance diminue.

Contrairement aux collègues humains avec qui on peut discuter d'une implémentation, les modèles de langage ne peuvent expliquer leurs choix. Interroger un LLM sur sa logique ne produit qu'une réponse plausible mais inventée, car ces systèmes ne comprennent pas réellement ce qu'ils génèrent.

Coûts Artificiellement Bas : Une Bulle Prête à Éclater

L'économie des agents IA de codage repose sur des fondations fragiles. Les prix actuels ne reflètent absolument pas les coûts réels d'entraînement et d'exploitation des modèles de langage à grande échelle.

Le Modèle Économique Insoutenable des LLM

Les géants technologiques investissent des sommes astronomiques dans les infrastructures IA : GPU, mémoire, stockage et centres de données. Ces dépenses massives ne sont pas compensées par les revenus actuels. Les entreprises suivent le modèle Silicon Valley classique : construire d'abord, monétiser ensuite.

| Aspect Économique | Situation Actuelle | Risque à Moyen Terme |

|---|---|---|

| Prix utilisateur | Subventionné, déconnecté des coûts réels | Hausse de prix de plusieurs ordres de grandeur |

| Rentabilité | Largement négative pour la plupart des acteurs | Restructuration majeure du secteur |

| Dépendance | Croissante pour les entreprises utilisatrices | Vulnérabilité lors de l'ajustement tarifaire |

| Innovation | Espoir d'avancées miraculeuses | Incertitude sur les percées futures |

Les entreprises parient sur des innovations majeures, comparables au papier fondateur Attention Is All You Need de Google. Sans ces percées, la bulle éclatera inévitablement. Même les géants comme Google et Meta, avec leurs réserves financières considérables, devront ajuster leurs stratégies. Les acteurs plus petits, sans diversification, risquent la disparition pure et simple.

L'Illusion de la Rentabilité

Les outils exploitant des modèles génératifs à prix artificiellement bas créent une dépendance dangereuse. Lorsque les tarifs s'aligneront sur les coûts réels – et cela arrivera – de nombreuses entreprises se retrouveront dans une position intenable. Mieux vaut ne pas devenir trop dépendant des agents IA maintenant pour mieux résister à la tempête future.

Cette situation rappelle les enjeux soulevés autour de l'entraînement des modèles IA, où les coûts réels restent souvent opaques pour les utilisateurs finaux.

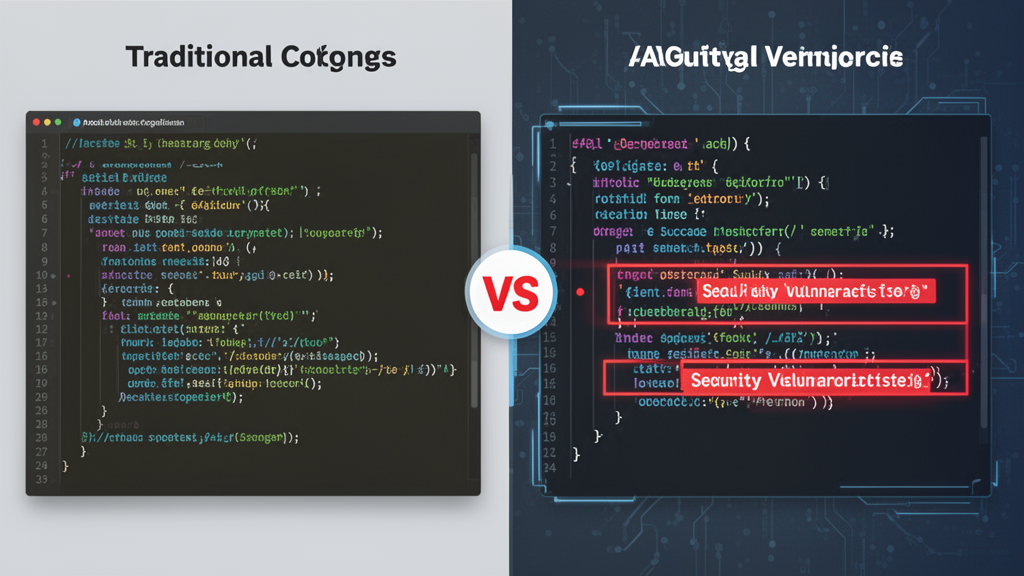

Injections de Prompts : Une Vulnérabilité Fondamentale

L'injection de prompts représente une faille de sécurité majeure des LLM, particulièrement préoccupante dans le contexte des agents de codage.

Comprendre la Vulnérabilité des LLM

Les modèles de langage sont intrinsèquement crédules. Leur fonctionnement – prédire le prochain token dans une séquence – les rend incapables de distinguer fiablement les instructions légitimes des commandes malveillantes enfouies dans le contexte. Cette limitation n'est pas un bug, mais une caractéristique fondamentale de leur architecture.

Malgré les améliorations apportées par les fournisseurs de LLM, toutes les corrections ressemblent à du colmatage de fuites avec du ruban adhésif. L'incapacité des LLM à différencier instructions et données constitue un problème structurel probablement impossible à résoudre complètement.

Le Nouveau Vecteur d'Attaque des Agents IA

Jusqu'à présent, les injections de prompts concernaient principalement des sessions individuelles où un utilisateur tentait de contourner les garde-fous du système. Avec les agents IA de codage, le paysage des menaces s'élargit considérablement.

Des acteurs malveillants peuvent désormais :

- Empoisonner des sites web avec des instructions cachées

- Envoyer des emails contenant des commandes dissimulées

- Infiltrer des dépôts de code avec des prompts malicieux

- Manipuler la documentation technique en ligne

Lorsqu'un agent IA recherche des exemples de code sur le web ou consulte des emails, il peut tomber sur ces instructions malveillantes et les exécuter sans discernement. Le résultat ? Du code compromis injecté directement dans votre base de code de production.

Cette problématique rejoint les préoccupations de sécurité évoquées dans notre guide sur la gestion sécurisée des cookies, où la validation des entrées constitue un enjeu crucial.

Propriété Intellectuelle et Licences : Un Terrain Juridique Miné

Les questions de copyright et de licences logicielles représentent peut-être l'obstacle le plus complexe à l'adoption des agents IA de codage en production.

L'Origine Trouble des Données d'Entraînement

Les grands modèles de langage ont été entraînés sur d'immenses corpus de code, souvent sans vérifier scrupuleusement les licences. Cette pratique soulève des questions juridiques majeures : le code généré par un agent IA peut-il violer des droits d'auteur ou des termes de licence ?

La réponse reste floue juridiquement, mais les risques sont réels :

- Violation involontaire de licences : Un agent IA peut reproduire du code sous licence GPL dans un projet propriétaire

- Contamination de la propriété intellectuelle : Du code breveté pourrait être répliqué sans autorisation

- Responsabilité légale : Qui est responsable si du code généré par IA viole des droits ? L'entreprise utilisatrice ? Le fournisseur du modèle ?

- Impossibilité de traçabilité : Contrairement à un développeur humain, on ne peut pas demander à un LLM d'où vient son inspiration

Les Limites de l'Indemnisation par les Fournisseurs

Certains fournisseurs d'agents IA proposent des garanties d'indemnisation en cas de litige de propriété intellectuelle. Ces protections, bien qu'utiles, présentent des limites importantes. Les conditions d'indemnisation comportent souvent des exclusions, des plafonds et des exigences procédurales strictes.

De plus, même avec une indemnisation, les dommages réputationnels et opérationnels d'un litige de propriété intellectuelle peuvent être considérables. Le temps et les ressources nécessaires pour défendre votre position, même si vous êtes finalement indemnisé, représentent un coût substantiel.

Comparaison : Agents IA vs Développement Traditionnel

Pour mieux visualiser les implications de ces problématiques, examinons une comparaison directe entre les approches.

| Critère | Agents IA de Codage | Développement Traditionnel |

|---|---|---|

| Vitesse initiale | Très rapide pour prototypes | Plus lente mais prévisible |

| Maintenabilité | Difficile à évaluer, compétences en déclin | Équipe compétente et évolutive |

| Coût réel | Artificiellement bas, augmentation probable | Transparent et stable |

| Sécurité | Vulnérable aux injections de prompts | Processus de sécurité établis |

| Propriété intellectuelle | Zone grise juridique | Traçabilité et conformité claires |

| Apprentissage d'équipe | Atrophie des compétences | Développement continu de l'expertise |

Cette comparaison ne suggère pas que l'IA n'a aucune place dans le développement logiciel. Comme expliqué dans notre analyse des nouvelles architectures de modèles, l'innovation continue dans le domaine de l'IA. Mais les agents IA de codage actuels, basés sur les LLM, présentent trop de risques pour la production.

Utilisations Légitimes de l'IA dans le Développement

Rejeter les agents IA de codage pour la production ne signifie pas bannir complètement l'IA du processus de développement. Plusieurs usages restent pertinents et à faible risque.

Assistance à la Documentation et à la Compréhension

Les LLM excellent dans la génération de documentation de base, l'explication de concepts complexes ou la synthèse d'informations. Utilisés comme assistants pour comprendre une nouvelle bibliothèque ou un framework inconnu, ils peuvent accélérer l'apprentissage – à condition de toujours vérifier leurs affirmations.

Génération de Tests et de Données Factices

Créer des tests unitaires répétitifs ou générer des données de test représente un usage approprié. Le risque est limité car ces éléments sont vérifiés et ne constituent pas le cœur de la logique métier. L'IA peut également suggérer des cas limites auxquels un développeur n'aurait pas pensé.

Refactorisation Supervisée

Pour des tâches de refactorisation mécaniques – renommer des variables de manière cohérente, restructurer des fichiers – les LLM peuvent apporter de la valeur sous supervision étroite. L'important est que le développeur comprenne parfaitement le changement et puisse en valider chaque aspect.

Ces applications rappellent l'approche prudente recommandée dans notre guide sur les bonnes pratiques JavaScript : utiliser les outils modernes intelligemment, sans abandonner la compréhension fondamentale.

L'Avenir des Agents IA : Entre Espoir et Réalisme

Certains affirment que les problèmes actuels des agents IA de codage seront résolus par les prochaines générations de modèles. Cette position mérite examen.

Les Limites Fondamentales des LLM

Les injections de prompts et l'incapacité à raisonner véritablement ne sont pas des bugs à corriger, mais des caractéristiques inhérentes à l'architecture des transformers. Même des modèles comme ceux développés dans le cadre de partenariats stratégiques majeurs font face à ces limitations structurelles.

L'intelligence artificielle générale (AGI), souvent présentée comme la solution ultime, reste un objectif mal défini et probablement lointain. Parier l'avenir de son code de production sur une hypothétique percée technologique constitue une stratégie risquée.

Un Changement de Paradigme Nécessaire

Pour que les agents IA deviennent réellement fiables en production, il faudrait probablement un changement d'architecture fondamental, s'éloignant des LLM actuels. Des approches hybrides combinant raisonnement symbolique et apprentissage statistique pourraient offrir de meilleures garanties, mais nous n'en sommes pas encore là.

Recommandations Pratiques pour les Équipes de Développement

Face à la pression croissante d'adopter les agents IA de codage, voici des recommandations concrètes :

- Maintenir les compétences de codage actives : Même si vous expérimentez avec l'IA, assurez-vous que votre équipe continue à écrire du code régulièrement

- Établir des politiques claires : Définissez précisément où et comment l'IA peut être utilisée dans votre processus de développement

- Privilégier les usages à faible risque : Documentation, tests, prototypage plutôt que code de production critique

- Former sur les risques : Éduquez votre équipe sur les injections de prompts et les limitations des LLM

- Auditer régulièrement : Si vous utilisez des outils IA, vérifiez périodiquement qu'ils n'ont pas introduit de vulnérabilités ou de violations de licence

- Prévoir un plan B : Ne devenez pas dépendant d'outils dont le modèle économique est insoutenable

Ces principes s'alignent avec les réflexions sur l'exploitation stratégique de l'IA : utiliser la technologie intelligemment sans compromettre la viabilité à long terme.

Au-Delà du Code : Les Implications Organisationnelles

L'adoption massive d'agents IA de codage ne concerne pas uniquement la technique, mais transforme l'organisation entière.

Impact sur la Culture d'Entreprise

Une équipe qui délègue massivement à des agents IA perd progressivement sa culture technique. Les discussions approfondies sur l'architecture, les revues de code enrichissantes et le mentorat entre pairs s'appauvrissent. Cette érosion culturelle affecte la capacité d'innovation et d'adaptation de l'organisation.

Dépendance Stratégique Envers des Tiers

Construire votre stack technique sur des agents IA propriétaires crée une dépendance stratégique majeure. Contrairement à un framework open source que vous pouvez maintenir si nécessaire, vous êtes à la merci des décisions tarifaires et stratégiques du fournisseur d'IA.

Cette problématique rappelle les enjeux soulevés par l'adoption de l'IA dans le secteur public, où la souveraineté technologique constitue une préoccupation majeure.

Conclusion : Vers une Adoption Réfléchie de l'IA

Les agents IA de codage représentent une avancée technologique impressionnante, mais leur adoption pour générer du code de production soulève des questions fondamentales que l'industrie n'a pas encore résolues. L'atrophie des compétences, les coûts artificiellement bas, les vulnérabilités aux injections de prompts et les zones grises juridiques constituent des obstacles sérieux.

Cela ne signifie pas que l'IA n'a pas sa place dans le développement logiciel. Utilisée judicieusement pour la documentation, les tests ou l'apprentissage, elle apporte une réelle valeur. Mais remplacer les développeurs humains par des agents IA pour écrire du code de production reste prématuré et risqué.

L'approche la plus sage consiste à maintenir les compétences techniques de votre équipe, à utiliser l'IA comme assistant plutôt que comme remplaçant, et à rester vigilant face aux promesses trop belles des vendeurs de solutions IA. La technologie évoluera, les modèles économiques se stabiliseront, et peut-être qu'un jour les limitations actuelles seront surmontées. Mais ce jour n'est pas encore arrivé en mars 2026.

Pour aller plus loin dans votre compréhension et utilisation stratégique de l'intelligence artificielle, créez votre compte gratuit sur Roboto et explorez nos outils de génération de contenu conçus pour augmenter votre productivité sans compromettre votre expertise.